Terça-feira, 31 de março de 2026

Terça-feira, 31 de março de 2026

Por Redação O Sul | 15 de novembro de 2019

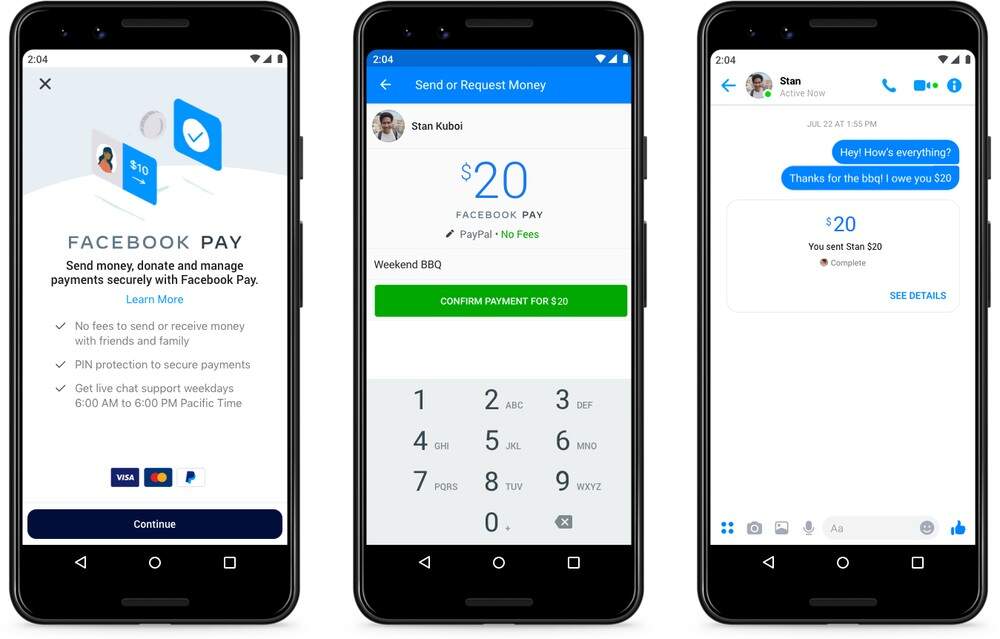

O Facebook lançou, nesta semana, o Facebook Pay, sistema que promete facilitar o envio e o recebimento de pagamentos em todas as redes sociais e aplicativos da empresa, como WhatsApp e Instagram. Estava previsto que a novidade chegaria aos Estados Unidos ainda nesta semana, a princípio disponível apenas no Facebook e no Messenger.

Os usuários poderão usar o Facebook Pay para compras em jogos, aquisição de ingressos, arrecadação de fundos — as chamadas “vaquinhas” virtuais — e envio de dinheiro para amigos.

Com o novo sistema, será possível adicionar um método de pagamento e utilizá-lo para fazer compras e outras transações nos aplicativos do Facebook para Android e iPhone (iOS), sem precisar repetir as informações de cobrança. Vale citar que não há previsão de lançamento da plataforma no Brasil.

O Facebook Pay pode ser configurado em cada app de uma vez ou ativado em todos ao mesmo tempo. Em outras palavras, o usuário pode, caso deseje, habilitar o sistema apenas no Instagram, mas não no WhatsApp, por exemplo.

A ferramenta suporta a maioria dos principais cartões de crédito e débito, assim como o PayPal. As transações são processadas em parceria com grandes empresas de pagamentos online, a exemplo do próprio PayPal. Segundo a empresa, o sistema é separado da carteira virtual Calibra, que funciona em uma rede diferente com a criptomoeda Libra.

A companhia não revelou quando o sistema de pagamento estará disponível em todos os seus aplicativos — incluindo Instagram e WhatsApp — nem quando será lançado internacionalmente. Segundo a assessoria do Facebook, o serviço não tem previsão de chegada ao Brasil.

Remoção de contas

O Facebook removeu 3,2 bilhões de contas falsas e mais de 15,6 milhões de postagens de conteúdo que incitava abuso infantil ou suicídio entre os meses de abril e setembro de 2019. Esse número é mais do que o dobro do anunciado no mesmo período do ano passado — 1,55 bilhão. As informações foram divulgadas em um relatório de moderação publicado por Guy Rosen, vice-presidente de integridade da empresa, na última quarta-feira (13).

No levantamento, o executivo ainda ressaltou que recursos de inteligência artificial foram aprimorados para identificar postagens que vão contra suas políticas. “Estamos identificando imagens e sequências de texto idênticas que já foram removidas como discurso de ódio, além de classificadores de aprendizado de máquina que analisam detalhes, como linguagem, reações e comentários de uma postagem”, completou.

Pela primeira vez, a companhia também acrescentou resultados de moderação do Instagram. No caso, foram eliminados 754 mil posts relacionados com abuso infantil; enquanto no Facebook esse número foi de 11,6 milhões. Já quanto a conteúdos ligados à incitação ao suicídio ou lesão corporal, na rede social principal foram apagados 2,5 milhões de publicações; no app de imagens, essa quantidade foi de 845 mil.

O vice-presidente de integridade também anunciou no relatório um novo site dedicado a informar quais tipos de conteúdo podem ser classificados como abusivos, conforme as políticas do Facebook. “Para que as pessoas possam ver exemplos de como nossos padrões da comunidade se aplicam a diferentes tipos de conteúdo”, disse Rosen.

Contradições

Zuckerberg disse recentemente que planejava trazer conversas criptografadas de ponta a ponta para o Messenger, assim como acontece no WhatsApp. A notícia não tem sido bem vista por autoridades de segurança e política dos Estados Unidos e de parte da Europa, que entendem a medida como uma abertura para atuação de criminosos e redes de pedofilia.

Essa mudança ainda pode ser encarada como uma contradição diante das ações trimestrais da companhia no combate a conteúdos de abuso no Facebook e Instagram, conforme o relatório mencionado. O assunto segue envolto em polêmica, entre garantir a privacidade dos usuários e, ao mesmo tempo, evitar que eles a usem como instrumento de atividades ilegais, fake news e discurso de ódio.

Os comentários estão desativados.